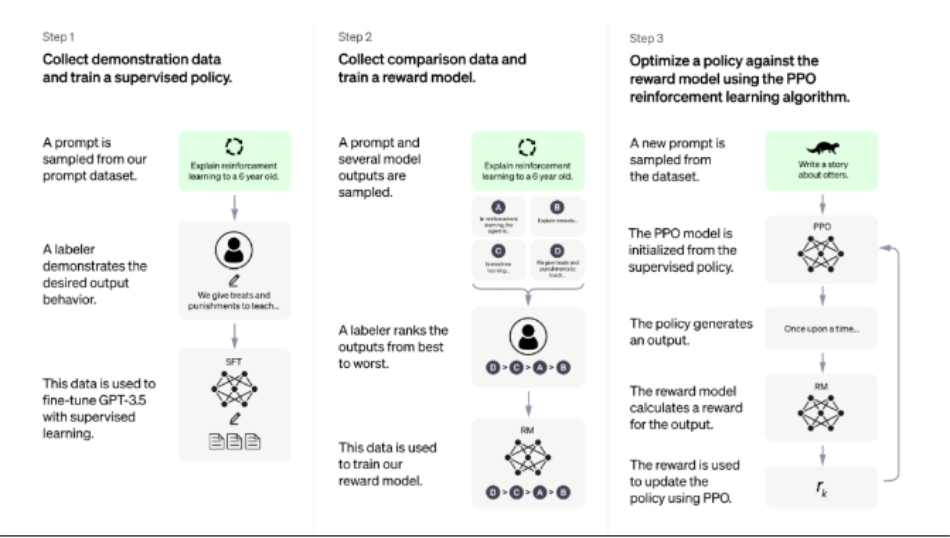

ChatGPT-ն OpenAI-ի կողմից մարզված առաջադեմ արհեստական բանականության չաթբոտ է, որը շփվում է զրույցի միջոցով: Երկխոսության ձևաչափը հնարավորություն է տալիս ChatGPT-ին պատասխանել հետագա հարցերին, ընդունել իր սխալները, վիճարկել սխալ նախադրյալները և մերժել անպատշաճ հարցումները:

GPT տեխնոլոգիան կարող է օգնել մարդկանց արագ և ճշգրիտ կոդ գրել՝ որպես հուշում օգտագործելով բնական լեզուն: GPT-ն կարող է վերցնել տեքստային հուշում և ստեղծել տրված առաջադրանքին հարմարեցված կոդ: Այս տեխնոլոգիան ունի մշակման ժամանակը կրճատելու ներուժ, քանի որ այն կարող է արագ և ճշգրիտ կոդ ստեղծել: Այն կարող է նաև օգնել նվազեցնել սխալների ռիսկը, քանի որ GPT-ն կարող է ստեղծել կոդ, որը կարող է անմիջապես փորձարկվել և օգտագործվել:

Ներքին փաստաթղթի համաձայն՝ Google-ը կոդավորման հարցազրույցի հարցեր է ուղարկել ChatGPT-ին և, արհեստական բանականության պատասխանների հիման վրա, որոշել է, որ այն կվարձվի երրորդ մակարդակի ինժեներական պաշտոնի համար։

Հաղորդվում է, որ հետազոտողները վերջերս ChatGPT-ին հանձնել են Միացյալ Նահանգների բժշկական լիցենզավորման քննություն: Դեկտեմբերին հրապարակված զեկույցում ChatGPT-ն «բոլոր երեք քննություններում էլ ցուցաբերել է հանձնման շեմին կամ դրան մոտ արդյունք՝ առանց որևէ վերապատրաստման կամ խրախուսման»:

ChatGPT, իրո՞ք այդքան հուսալի է։

«Մեծ լեզվական մոդելների սահմանափակումներից մեկն այն է, որ մենք ի վիճակի չենք հասկանալ մեր ստեղծած բառերի համատեքստը կամ իմաստը։ Մենք կարող ենք տեքստ ստեղծել միայն որոշակի բառերի կամ բառերի հաջորդականությունների միասին հայտնվելու հավանականության հիման վրա՝ մեզ տրված մարզման տվյալների հիման վրա։ Սա նշանակում է, որ մենք չենք կարող բացատրություններ կամ դատողություններ տալ մեր պատասխանների համար, և մենք միշտ չէ, որ կարող ենք ստեղծել պատասխաններ, որոնք լիովին համահունչ են կամ իմաստ ունեն զրույցի համատեքստում»։

«Մեկ այլ սահմանափակումն այն է, որ մենք հասանելիություն չունենք մարդու ունեցած գիտելիքների հսկայական քանակին։ Մենք կարող ենք տրամադրել միայն այն տեղեկատվությունը, որի վրա մենք մարզվել ենք, և հնարավոր է չկարողանանք պատասխանել այն հարցերին, որոնք գտնվում են մեր մարզման տվյալներից դուրս»։

«Վերջապես, քանի որ մենք մարզվում ենք մեծ քանակությամբ տվյալների վրա, երբեմն կարող ենք ստեղծել պատասխաններ, որոնք պարունակում են վիրավորական կամ անպատշաճ լեզու։ Սա միտումնավոր չէ, բայց դա մեզ տրված մարզման տվյալների և տեքստ ստեղծելու համար օգտագործվող ալգորիթմների սահմանափակում է»։

Վերոնշյալ լուրը վերցված է China Daily-ից։

Փազլների դիզայնի ոլորտում մեր դիզայներները նույնպես սպառնալիք են զգում Chat GPT-ից, բայց մեր դիզայնի աշխատանքն ավելի շատ մարդկային ստեղծագործության և հասկացողության ավելացման մասին է, որը մենք չէինք կարող ավելացնել մարդկային դիզայների փոխարեն, ինչպիսիք են գույնի զգացողությունը և մշակութային ինտեգրումը, որը մարդիկ ցանկանում են արտահայտել փազլում։

Հրապարակման ժամանակը. Մայիս-08-2023